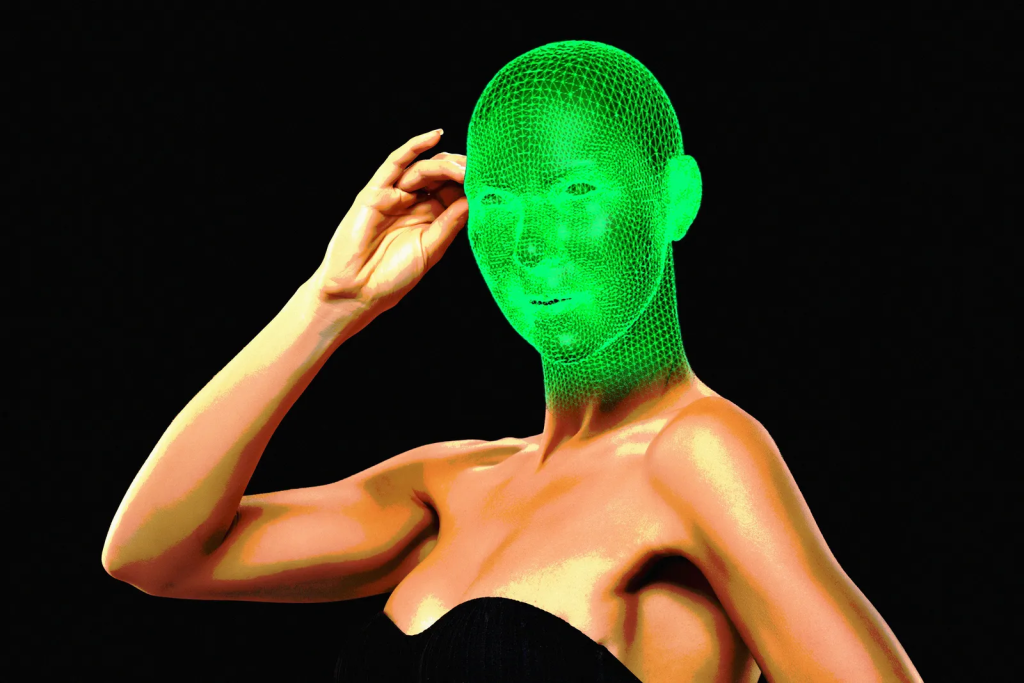

DeepFake Pornography Market : Deepfakeના લીધે ઘણાં કન્ટેન્ટ ક્રિએટર્સ અને સ્કેમર્સ ફેક વિડિયો બનાવી રહ્યાં છે. શું તમે જાણો છો, કે હાલ આખી દુનિયામાં ઈન્ટરનેટ પર 1 લાખથી વધુ Deepfake પોર્ન વિડિયો પડેલા છે. એટલુ જ નહિ દરરોજ સેંકડો Deepfake પોર્ન વિડિયોની ક્લિપ ઈન્ટરનેટ પર અપલોડ થઈ રહી છે. ત્યારે સવાલ એ છે, કે આખરે કેઈ રીતે ડીપફેક પોર્ન વિડિયોનું માર્કેટ ધમધમી રહ્યું છે?

આ પણ વાંચો : સોનાનો રેટ ઓલટાઇમ હાઇ, વૈશ્વિક સ્તરે રેકોર્ડ ઊછાળો

ઈન્ડિયા ટુડેએ ઓપન સોર્સ ઈન્ટેલિજન્સને લઈ એક તપાસ કરી અને જાણવા મળ્યું, કે આ આર્ટિફિશિયલ ઈન્ટેલિજન્સ ટેક્નોલોજીના કારણે Deepfake Pornography એક મોટો બિઝનેસ બની ગયું છે. સિન્થેટિક પોર્ન ઘણાં વર્ષોથી છે. જ્યારે AI અને ટેક્નોલોજીની મદદથી હવે આ કામ ખૂબ સરળ થઈ ગયુ છે. તેનાથી તેઓ વધુ કમાણી કરી રહ્યાં છે. કેટલાક લોકો તેને બનાવી અને ડિસ્ટ્રીબ્યુટ કરીને કમાણી કરી રહ્યાં છે.

ખબરી ગુજરાતની વ્હોટ્સઍપ ચેનલમાં જોડાવા માટે અહીં ટેપ કરો.

Home Security Heroesના રિપોર્ટ, 2023 સ્ટેટ ઓફ ડીપફેક રિપોર્ટમાં જણાવાયું છે, કે 2023માં 2019ની સરખામણીએ 550 ટકાનો નફો થયો છે. અમેરિકાની ઓનલાઈન ટ્રાફિક એનાલિટિક્સ સર્વિસ Semrush અનુસાર, જુલાઈ અને ઓગસ્ટ વચ્ચે ટોપ 10 વેબસાઈટ્સે એક્સક્લુઝિવલી ડીપફેક પોર્નને હોસ્ટ કરીને 30 કરોડથી વધુ વ્યુઝ મેળવ્યા છે. જેમાં MrDeepFakes ટોપર પર છે. જેની ઓક્ટોબર 2023 દરમિયાન 11.18 કરોડ યુઝર્સે વિઝટ કરી છે.

ડીપફેક વિડિયોથી ઘણાં લોકો અને કંપનીઓને કમાણી કરવાની તક મળી રહી છે. ત્યારે સવાલ એ છે કે આ ફેક વિડિયોથી શું સમસ્યા છે? કહીકતમાં Deepfakeના ફેક વિડિયોના લીધે વાસ્તવિક દુનિયામાં રહેતા લોકોને ઘણું નુકસાન થઈ શકે છે. તેની મદદથી ઘણાં લોકો બ્લેકમેલિંગનું કામ કરી રહ્યાં છે. તેનું એક મોટુ ઉદાહરણ Sextortion છે.

તાજેતરમાં જ ભારતમાં Deepfakeનો ઉપયોગ કરી લોકો સાથે છેતરપિંડીના ઘણાં બનાવ સામે આવ્યાં છે. જેમાં એક કેસ ગાઝિયાબાદ જિલ્લામાંથી સામે આવ્યો હતો. જ્યાં એક વ્યક્તિએ ફેસબુક પર કોલ રિસિવ કર્યો અને પછી તેણે આપઘાત કરી લીધો.

આ પણ વાંચો : ગુજરાત સરકારે આઈટી પોલીસી કરી જાહેર, 1 લાખ નોકરીનું થશે સર્જન

હકીકતમાં, વિડિયોમાં કોલમાં સામે નગ્ન અવસ્થામાં મહિલા જોવા મળી હતી. ત્યાર બાદ તેને એક ડિપફેક વિડિયો મળ્યો અને એક વ્યક્તિને નકલી પોલીસ બનીને 74 હજાર રૂપિયા માંગ્યા. આ મામલે તે વ્યક્તિને એટલો હેરાન કરવામાં આવ્યો કે તેને આત્મહત્યા કરી લીધી. 2023 સ્ટટે ઓફ ડીપફેક રિપોર્ટમાં જણાવાયું છે કે આશરે 98 ટકા Deepfake પોર્નને લગતા હોય છે. 99 ટકા વિડિયોમાં એક મહિલાને ફેક વિક્ટિમ બનાવવામાં આવે છે.

Deepfakeની મદદથી તૈયાર થનાર વિડિયો મુખ્યત્વે બે પ્રકારના હોય છે. પહેલા પ્રકારમા ડિપફેક વિડિયોમાં વ્યક્તિના ચહેરા સાથે ચેડા કરવામાં આવે છે. જ્યારે બીજા પ્રકારમાં એક કમ્પ્યુટર હાઇપર રિયલિસ્ટિક ફેસનો ઉપયોગ કરવામાં આવે છે. જેનું કોઈ અસ્તિત્વ જ નથી. પહેલી કેટેગરીમાં એક અસલી વ્યક્તિનો ચહેરો, અન્ય તસવીર કે વિડિયોમાં લગાવી શકાય છે. એઆઈ ટૂલથી આ કામ ખૂબ સરળ થઈ ગયું છે.

એવી ઘણી એપ્લિકેશન છે, કે જે માત્ર 40 રૂપિયાનામાં 15 સેકંડનો પોર્ન વિડિયો તૈયાર કરી આપે છે. આ રીતના વિડિયો જનરેટ કરવા માટે ઘણા પ્રકારના સોફ્ટવેઅર ઉપલબ્ધ છે. સાથે જ ડિસક્લેયર આપવામાં આવ્યું છે કે આ ફિચર્સ માત્ર મનોરંજન માટે છે.