उद्भव त्रिपाठी, ख़बरीमीडिया

Ghaziabad: AI जिन्हें आर्टिफिशियल इंटेलिजेंस भी कहते हैं इन दिनों खूब चर्चा में है, आपने हाल ही में अभी बॉलीवुड अभिनेत्री रश्मिका मंधाना का एक सोशल मीडिया (Social Media) पर जरूर देखा होगा, लेकिन हैरानी की बात यह है कि वह वीडियो रश्मिका का था ही नहीं वह तो AI की मदद से बनाया गया डीपफेक (Deepfake) वीडियो था। अब कुछ ऐसा ही गाजियाबाद (Ghaziabad) से भी हर महीने कई मामले सामने आ रहे हैं। गाजियाबाद की पुलिस के अनुसार, हर महीने ऐसे 10-15 केस आते हैं। लगातार बढ़ते केस को देखते हुए अब गाजियाबाद पुलिस (Ghaziabad Police) इसकी जांच में जुट गई है। पुलिस ने साइबर सेल को इस संबंध में सही से जांच करने को कहा है। साइबर सेल जांच में कई एक्सपर्ट की मदद ले रही है।

ख़बरीमीडिया के Whatsapp ग्रुप को फौलो करने के लिए tau.id/2iy6f लिंक पर क्लिक करें

ये भी पढ़ेंः DDA की लग्ज़री हाउसिंग स्कीम..5 कमरों के साथ टेरेस गार्डन

ये भी पढ़ेंः Delhi Demolition: दिल्ली में हजारों लोग होंगे बेघर..पढ़िए ख़बर

एडीसीपी क्राइम (ADCP Crime) ने जानकारी दी कि डीप फेक को लेकर साइबर एक्सपर्ट के साथ वह खुद लोगों को जागरूक कर रहे हैं। वह कहते हैं कि तकनीक के साथ नए चैलेंज आते ही हैं। ऐसे में साइबर सेल में कुछ ऐसे मामले आए हैं, जिसमें लोगों के अश्लील वीडियो वायरल किए गए हैं, जबकि वह उस वीडियो उनका है ही नहीं। हम ऐसे केस को गंभीरता से ले रहे हैं। सभी की जांच करवाई जा रही है। 100 से अधिक ऐसे मामलों पर नजर रखी जा रही है।

सोशल मीडिया बनता है डीपफेक तैयार करने वालों का हथियार

साइबर एक्सपर्ट करण भारद्वाज ने इन वीडियो को लेकर जानकारी दी कि सेलिब्रिटी तो अपने सोशल मीडिया अकाउंट पर एक्टिव होते हैं। साथ ही उनके फॉलोअर्स अधिक होने पर इस प्रकार की हरकत तुरंत सामने आ जाती है, लेकिन आम लोगों के साथ ऐसा नहीं होता है। जो लोग सोशल मीडिया पर एक्टिव हैं, उनके पब्लिक पोस्ट से फोटो और अन्य डिटेल लेकर साइबर क्रिमिनल्स वीडियो बना लेते हैं। इसके बाद ब्लैकमेलिंग का खेल शुरू होता है और पैसे ऐंठे जाते हैं।

इस तरह की समस्या परिवार को जरूर बताएं

मनोचिकित्सक संजीव त्यागी ने कहा कि अक्सर कुछ लोग सिर्फ अपने फायदे या किसी से बदला लेने के लिए तकनीक का गलत प्रयोग करते हैं। वर्तमान दौर में तकनीक एक चैलेंज है, लेकिन हमें उसके साथ ही रहना होगा। ऐसे में हमें ही कुछ सावधानियां बरतने की जरूरत है। अक्सर इस प्रकार के मामलों में वह लोग ज्यादा परेशान होते होते हैं, जो परिवार में ज्यादा बात नहीं करते हैं। वह अकेले अंदर ही अंदर परेशान रहते हैं। उन्हें इज्जत की चिंता सताने लगती है और वह या तो ठगों के जाल में फंस जाते हैं या फिर गलत कदम उठा लेते हैं। यहां यह समझना होगा कि अकेले इस प्रकार की समस्या से निपटा नहीं जा सकता है। पहले तो सोशल मीडिया से ज्यादा अपने परिवार को समय दें, इसके बाद भी इस प्रकार की समस्या आए तो इस बारे में अपने करीबियों को जरूर बताएं।

बचने के लिए करें यह काम

सोशल मीडिया अकाउंट को पब्लिक न करें।

सोशल मीडिया पर कोई भी फोटो पोस्ट कर रहे हैं तो उसे सिर्फ अपने फ्रेंड के लिए ही विजिबल रखें।

अगर आप सोशल मीडिया इन्फ्लुएंसर हैं तो भी अपने अकाउंट पर सुरक्षा का ध्यान रखें। फोटो शेयर करते वक्त अलर्ट रहें।

अपने बच्चों की वीडियो और फोटो सोशल मीडिया पर पोस्ट करने से बचें।

बच्चों को सोशल मीडिया के सही प्रयोग के बारे में जानकारी जरूर दें।

अगर वीडियो सामने आए तो ये करें

इस प्रकार के मामलों में तुरंत stopncii.org पर शिकायत दर्ज करें।

इसके बाद साइबर सेल में शिकायत दें और एफआईआर दर्ज करवाएं।

एफआईआर के बाद कुछ साइट डीप फेक विडियो की अधिक डिटेल देते हैं, एक्सपर्ट के साथ उससे मदद ले सकते हैं।

जिस सोशल मीडिया फ्लैटफॉर्म पर विडियो यूज होने की बात है। उसमें भी सिक्युरिटी में जाकर फेक के गलत प्रयोग की शिकायत दर्ज कराएं।

अगर आप उस वीडियो में नहीं हैं तो किसी भी कीमत पर ठगों के झांसे में न आएं और कोई भी रुपये ट्रांसफर न करें।

दूसरे के फोटो में महिला का चेहरा लगाया

मधुबन बापूधाम में रहने वाली एक महिला के कुछ वीडियो को अचानक सोशल मीडिया पर वायरल किया गया। वायरल करने का आरोप पूर्व में पड़ोस में रहने वाले एक युवक पर था, जबकि वह उसे जानती भी नहीं थी। ऐसे में उनका आरोप है कि उनका चेहरे का प्रयोग कर वीडियो तैयार किया गया है।

दोस्त पर लगाया आरोप

विजयनगर थाना क्षेत्र में रहने वाली एक युवती का आरोप है कि उसके वीडियो को कुछ सोशल मीडिया अकाउंट में पोस्ट किया गया, जबकि वह उसके वीडियो नहीं थे, सिर्फ उनका चेहरा था। पीड़िता ने यह आरोप अपने ही दोस्त पर लगाया था। जिसमें विजयनगर थाने में केस दर्ज किया गया था।

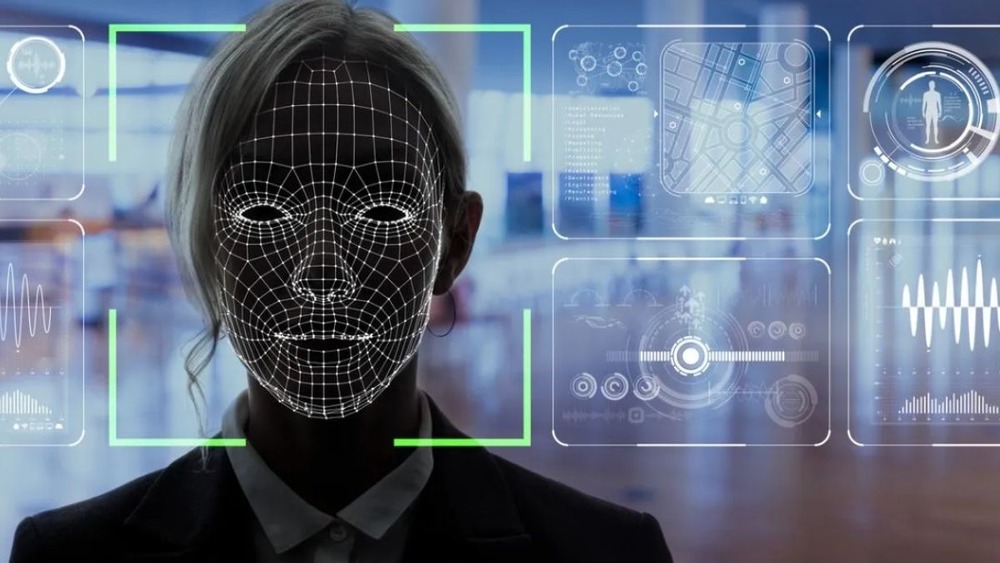

जानिए क्या है डीपफेक

किसी रियल वीडियो में दूसरे के चेहरे को फिट कर देने को डीपफेक कहते हैं, जिसे लोग सही की पहचान नहीं कर पाते हैं। डीपफेक से वीडियो और फोटो को बनाया जाता है। इसमें मशीन लर्निंग और आर्टिफिशियल इंटेलिजेंस की मदद ली जाती है। इसमें वीडियो और ऑडियो को टेक्नोलॉजी और सॉफ्टवेयर की मदद से बनाया जाता है। इसी डीपफेक से वीडियो बनाया जाता है। साधारण शब्दों में समझें तो इस टेक्नोलॉजी कोडर और डिकोडर टेक्नोलॉजी की मदद ली जाती है। डिकोडर सबसे पहले किसी इंसान के चेहरे को हावभाव और बनावट की गहन जांच करता है। इसके बाद किसी फर्जी फेस पर इसे लगाया जाता है, जिससे हुबहू फर्जी वीडियो और फोटो को बनाया जा सकता है।